ZAYA1-8B: 8B-модель с 760M активных параметров догоняет DeepSeek-R1 в математике

Новая открытая модель ZAYA1-8B от Firethering показывает впечатляющие результаты в математике и кодинге, обгоняя многие более крупные аналоги.

Мир open-source AI пополнился интересным релизом: модель ZAYA1-8B от Firethering. Это 8-миллиардная MoE (Mixture of Experts) модель, у которой при этом всего 760 миллионов активных параметров на каждый запрос. Звучит как магия? Примерно так же она и работает.

На бенчмарках AIME 2024 и MATH-500 ZAYA1-8B показывает результаты, сопоставимые с DeepSeek-R1 (671B параметров) и превосходит Qwen2.5-Math-7B-Instruct. В кодинге она тоже не подкачала: LiveCodeBench и Codeforces — всё на уровне.

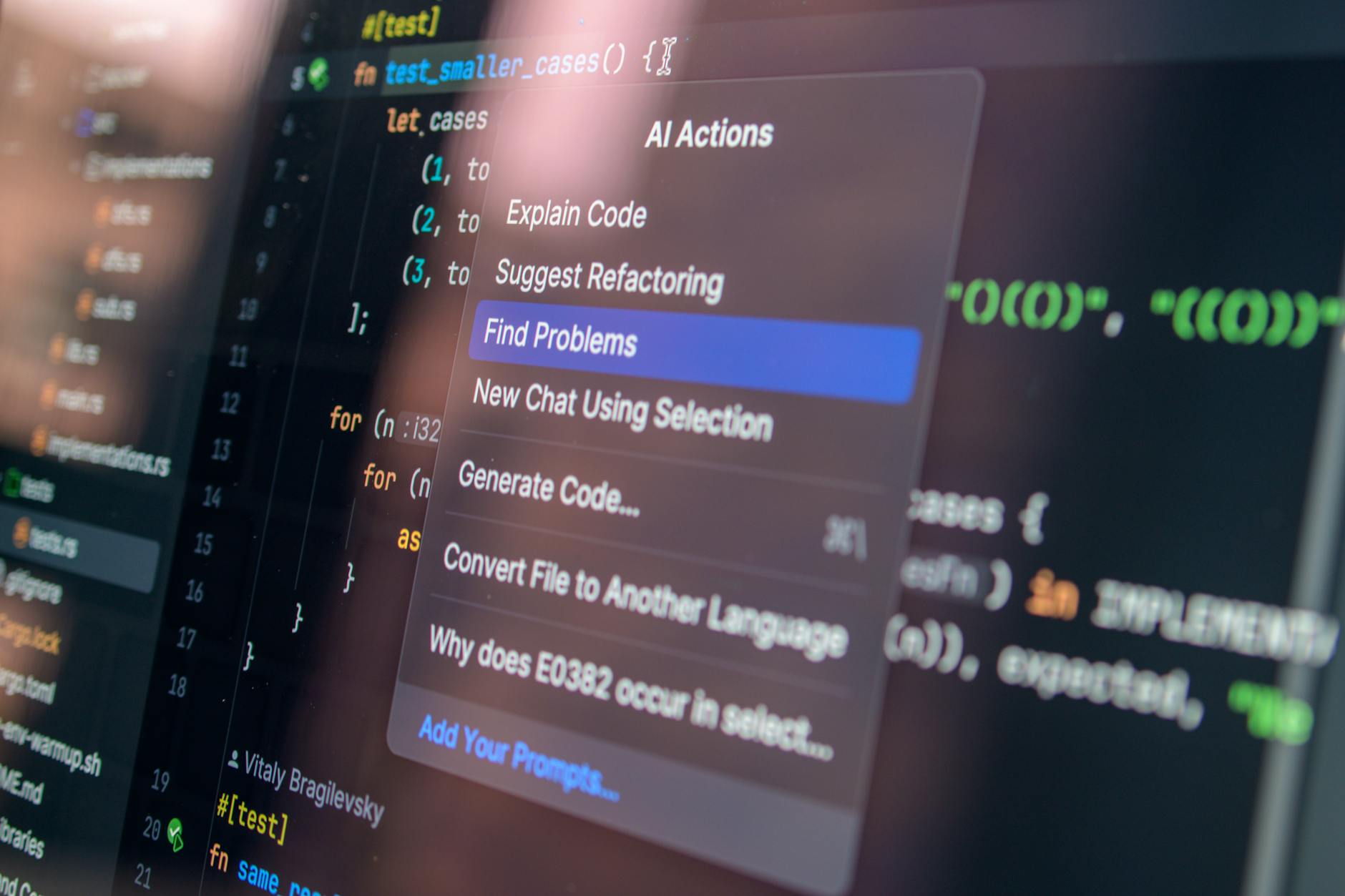

Почему это важно для разработчиков? - Эффективность: 760M активных параметров против 8B — это серьёзная экономия памяти и скорости инференса. - Open-source: можно дообучать, кастомизировать, встраивать в свои продукты. - Специализация: модель заточена под математику и код, что идеально для EdTech, ML-пайплайнов и инструментов разработчика.

Модель уже доступна на Hugging Face. Есть версия для чата (Instruct) и базовая. В планах — поддержка длинного контекста и мультимодальность.

Комментарий студии METABYTE: ZAYA1-8B — отличный пример того, как умная архитектура (MoE) позволяет получить большую производительность без гигантских затрат. Для стартапов, которые хотят внедрить AI-ассистента по коду или математике, это реальная альтернатива дорогим API. Мы бы присмотрелись к такой модели для интеграции в свои продукты.