Как остановить AI-словоблудие в продакшене: двухслойный валидатор для LLM

Избавляемся от надоедливых слов вроде «delve» и фактических ошибок с помощью простого, но мощного валидатора.

На этой неделе к нам обратился пользователь: в сгенерированной рассылке слово delve встретилось дважды. Дважды! Знакомая боль, правда? LLM обожают такие «умные» словечки, а ещё любят галлюцинировать факты. Пора это прекращать.

Двухслойная защита от AI-словоблудия

Решение, описанное в статье, строится на двух уровнях проверки:

1. Первый уровень — синтаксический и стилистический. Простейшие правила: запрещённые слова (delve, crucial, leverage), проверка длины абзацев, количества восклицательных знаков. Если текст похож на типичный AI-сгенерированный — блокируем или отправляем на доработку.

2. Второй уровень — семантический. Тут уже подключаем NLP-модели: проверка фактов (перекрёстные ссылки), тональность, когерентность. Если модель «галлюцинирует» — валидатор не пропустит.

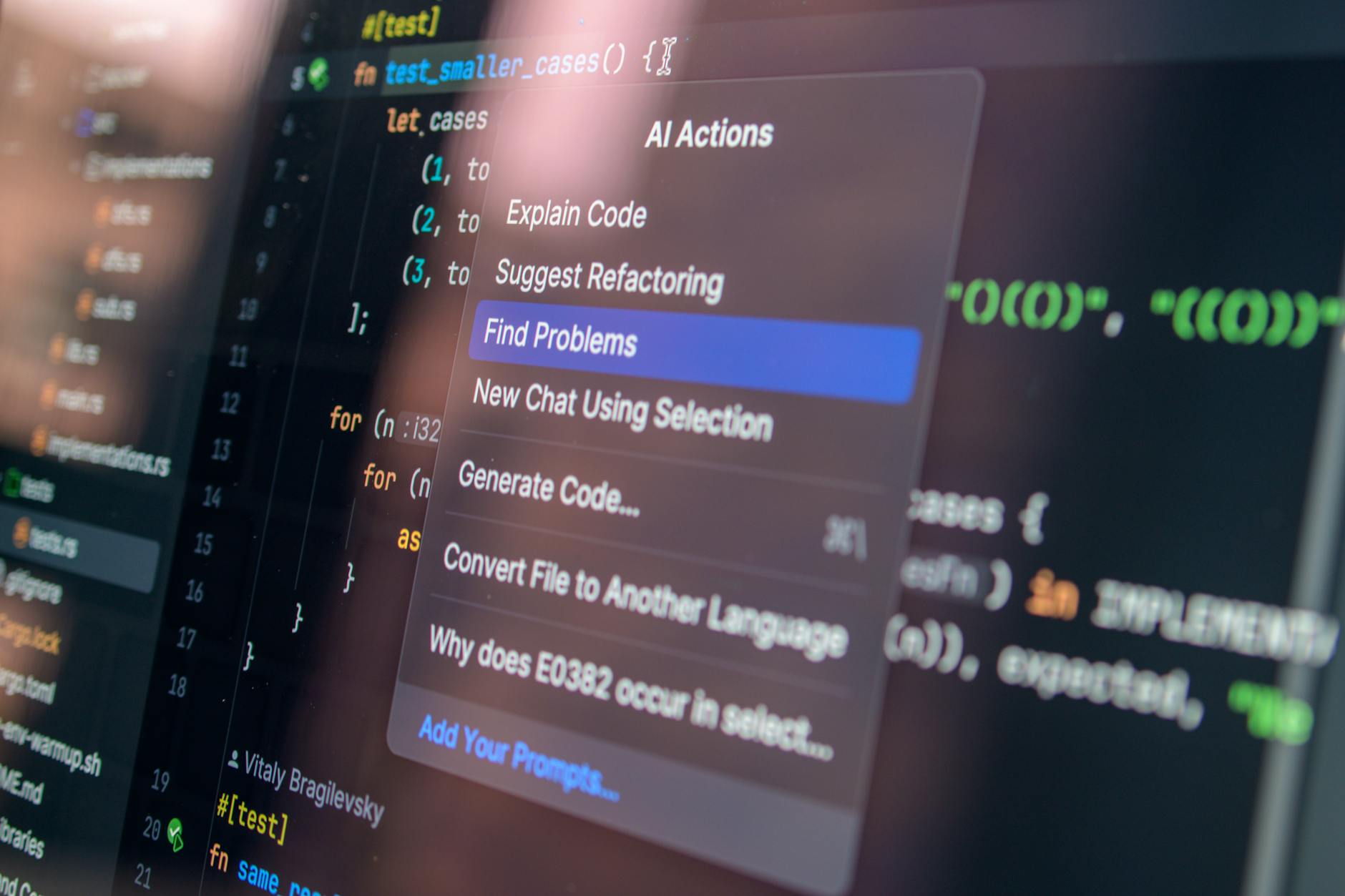

Всё это можно реализовать на JavaScript/TypeScript с помощью библиотек вроде `compromise` для NLP и кастомных правил. Пример кода из статьи:

const forbiddenWords = ['delve', 'leverage', 'synergy'];

if (forbiddenWords.some(word => text.includes(word))) {

throw new Error('AI slop detected');

}Комментарий студии METABYTE

Качество контента — это не только про SEO, но и про доверие. Если вы используете AI для генерации текстов в продукте, такой валидатор спасёт от репутационных потерь. В наших проектах мы часто внедряем подобные фильтры, чтобы пользователи видели чистый, полезный контент, а не «AI-словоблудие».