ERP на стероидах: как Gemma 26B MoE превращает учет в искусственный интеллект

Разработчик скрестил ERP-систему с гигантской языковой моделью — и это не шутка про «добавить AI во всё». Посмотрим, что вышло.

Ну что, очередной «AI-powered» проект? На этот раз — ERP-система, которую автор решил прокачать с помощью Gemma 26B MoE (Mixture of Experts). Если вы думали, что бухгалтерия и AI несовместимы, как Wi-Fi у бабушки и видеозвонки, — держитесь крепче.

Что под капотом?

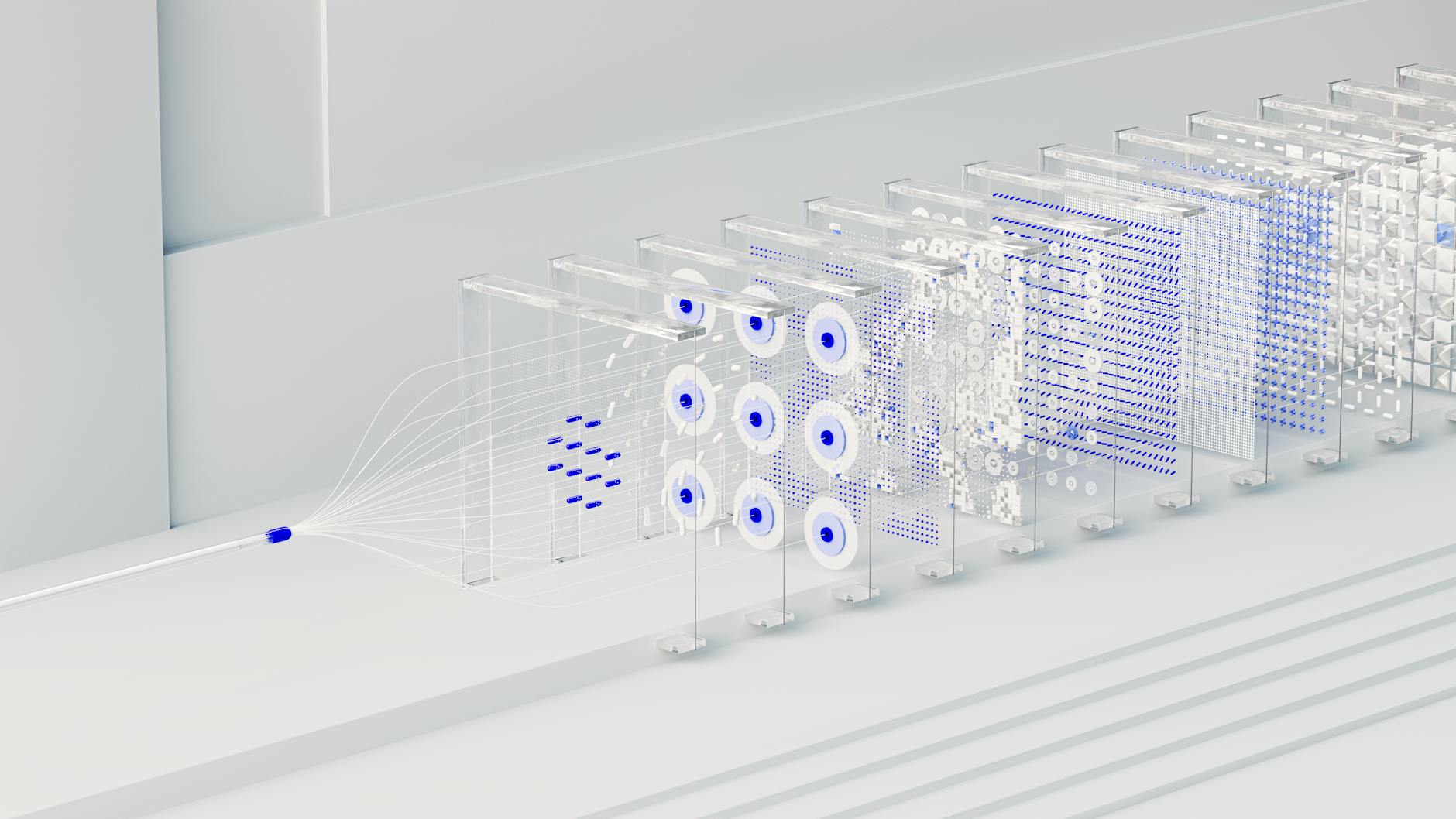

Автор взял модель Gemma 26B с архитектурой смеси экспертов — это когда вместо одного монолитного мозга у модели куча специализированных модулей, каждый отвечает за свою область. В контексте ERP это значит, что один «эксперт» разбирается в закупках, другой — в финансах, третий — в HR. И всё это без перекрестного обучения, просто за счет правильной маршрутизации запросов.

Звучит как магия? На деле — это попытка сделать ERP, которая не требует ручного ввода данных и сама предлагает оптимизацию. Например, вместо того чтобы заполнять 50 полей в JIRA (да, мы помним), вы просто описываете задачу на естественном языке — и система сама создает карточку, назначает ответственного и даже прикидывает сроки.

А что с реальностью?

Понятно, что 26 миллиардов параметров — это не игрушки. Для запуска такой модели нужен серьезный GPU-сервер, а не ноутбук с кофе. Но автор утверждает, что MoE-архитектура позволяет использовать модель эффективнее: активируются только нужные «эксперты», а не вся сеть целиком. Так что, возможно, это не просто хайп, а первый шаг к ERP, которая не будет тормозить на отчетах за прошлый квартал.

Конечно, до продакшена еще далеко — но сам подход заслуживает внимания. Особенно для стартапов, которые хотят автоматизировать всё, от закупок до зарплаты, без найма армии SAP-консультантов.

Комментарий студии METABYTE: Мы за то, чтобы AI решал рутину, а не создавал новую. Если Gemma 26B MoE поможет бухгалтерам спать спокойно, а не доделывать отчеты в 3 ночи — мы только за. Главное, чтобы модель не начала сама выписывать себе премии.